Receba nossas newsletters de graça

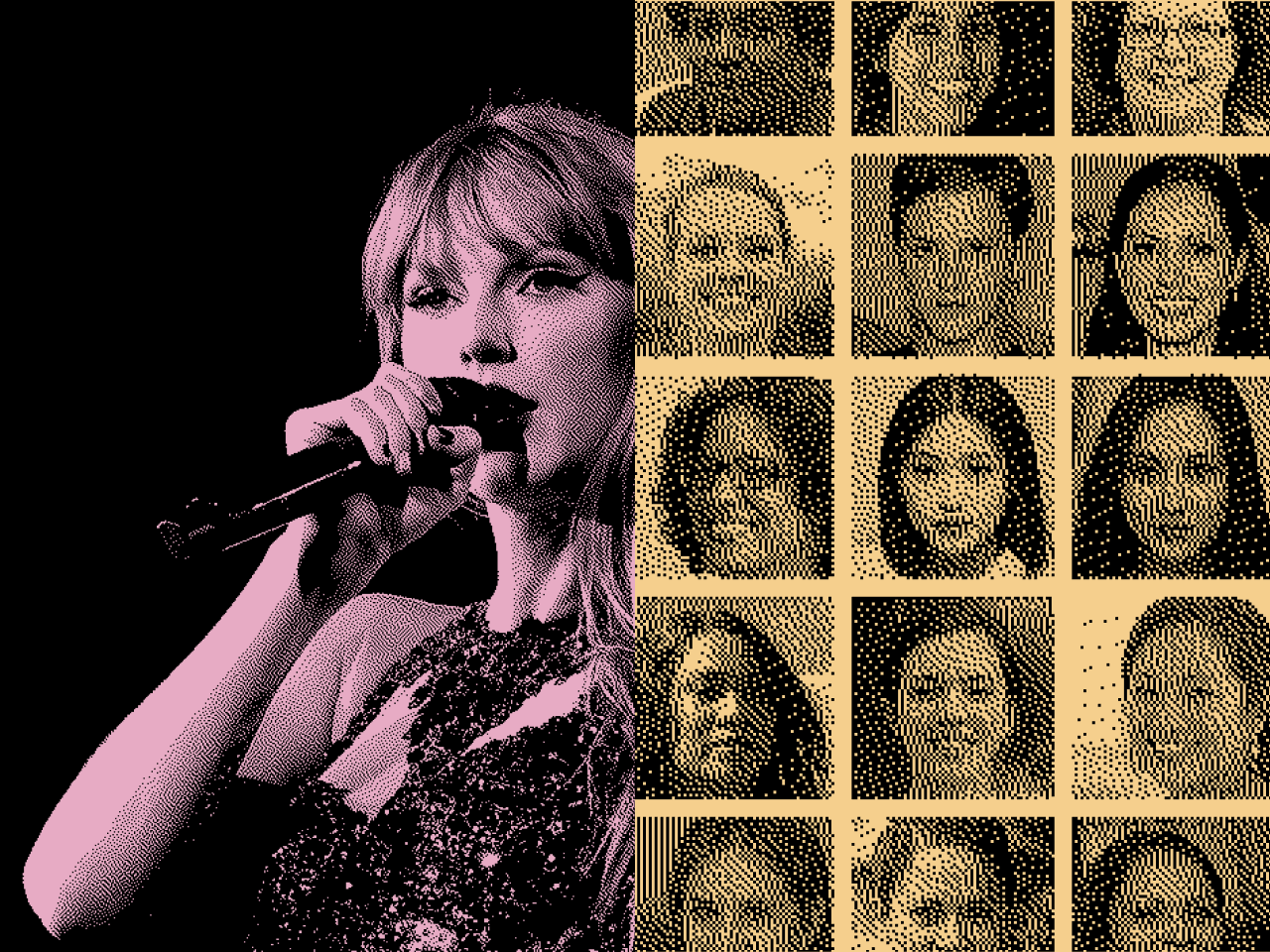

A emergência foi imediata: Taylor Swift foi alvo de trolls e seu rosto foi utilizado para fazer imagens falsas de pornografia pesada via inteligência artificial generativa, viralizando em chans e redes sociais e disparando alarmes a torto e a direito.

Rapidamente, redes sociais passaram a bloquear o conteúdo e a impedir seu compartilhamento. A base de fãs se mobilizou para defender a artista e até a presidência dos EUA entrou no assunto, dizendo estar "alarmada" com o uso de IA para essa finalidade e com esse alvo tão poderoso (se você mora em outro plano, Taylor Swift talvez seja a artista mais popular da atualidade).

Nem mesmo o Twitter de Elon Musk (o X), que tem sofrido com conteúdo extremista e falta de moderação, ficou parado. Embora sua inusitada e obtusa decisão de bloquear buscas pelo nome da artista na plataforma tenha acontecido após muitas horas do conteúdo circulando.

"Se isso acontece com a Taylor Swift, que tem o tamanho do aparato jurídico que ela tem, imagina com mulheres anônimas", disse Mariana Valente, professora da Universidade Saint Gallen, na Suíça, diretora do InternetLab e autora do livro "Misoginia na internet" (2023, Editora Fósforo).

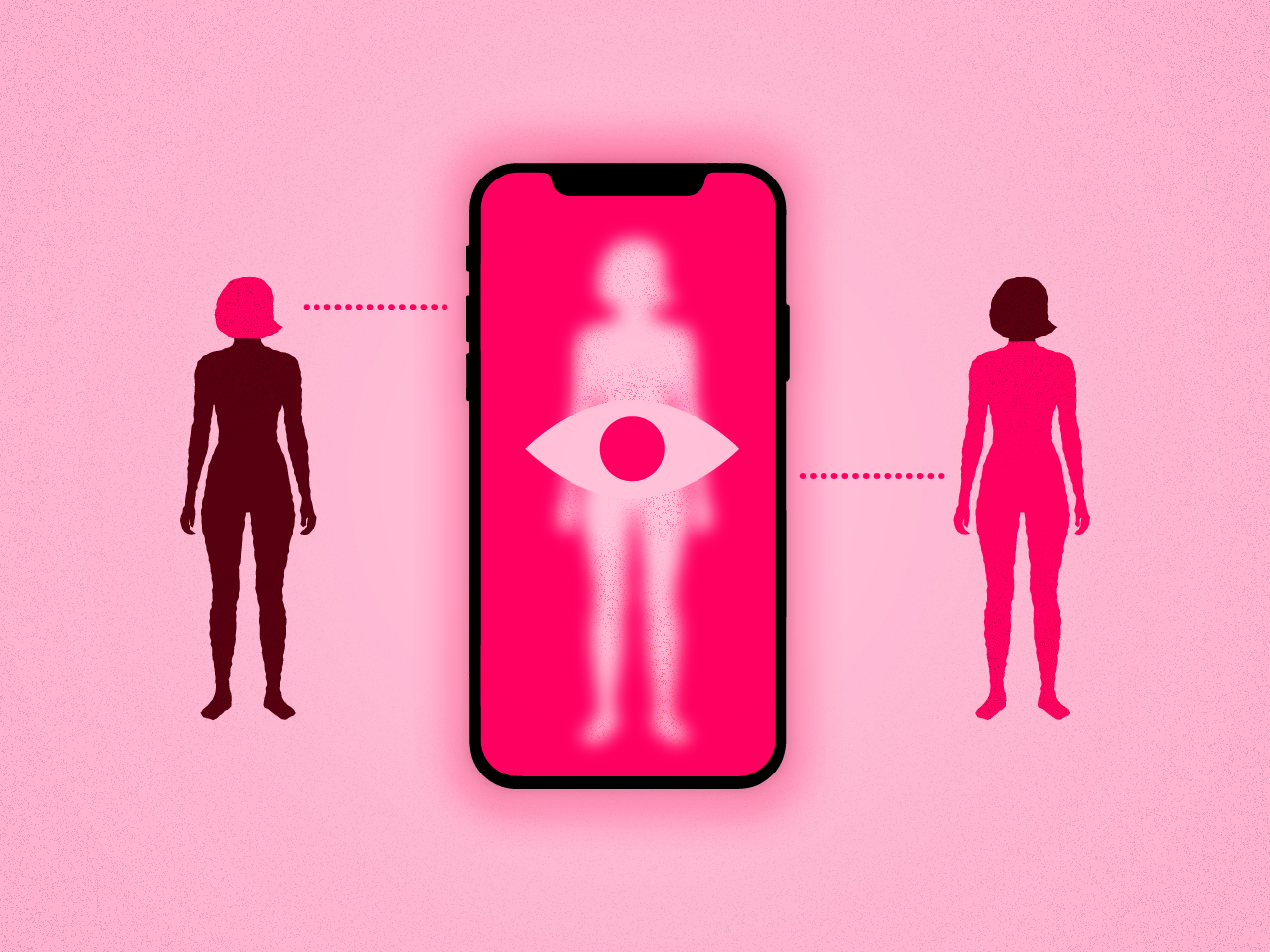

Antigamente, boa parte da violência sexual online contra mulheres vinha na forma de revenge porn (ou pornografia de vingança), que é quando homens compartilham fotos de mulheres nuas ou divulgam material sexual sem consentimento.

Se ter sua privacidade real violada já é uma grande violência (e inclusive crime), agora o problema atingiu um novo nível: mulheres pode ser difamadas e assediadas sem que sequer tenham feito o que as imagens mostram.

Claro, as imagens podem até não ser reais, mas o resultado para as vítimas pode ser semelhantemente danoso.

Ainda em 2023, o Núcleo foi um dos primeiros veículos a mostrar como as novas ferramentas de inteligência artificial estão sendo utilizadas para criar deep nudes de mulheres em fóruns anônimos, inclusive sob demanda.

Recentemente também mostramos como fotografias de mães solteiras no Tinder são utilizadas nesses chans para trocar dicas sobre como aliciar os filhos delas menores de idade.

As mulheres não têm um respiro no mundo digital, e se você não for tão famosa quanto a Taylor Swift, suas chances de ter alguma resposta de plataformas e autoridades é bem pequena.

Ajude o Núcleo a fazer análises como esta sobre os impactos das Big Tech na vida das pessoas. Custa apenas R$10.

Pelo menos tramita no Congresso um projeto de lei que aumenta a pena para quem registrar ou vazar conteúdo sexual não autorizado, incluindo também uso de inteligência artificial para a produção não consensual de deep nudes.

"Às vezes já existem projetos de lei, discussões, mas eles só movem quando acontece alguma coisa muito midiática", disse Valente.

Mas apenas punir quem compartilha esse conteúdo pode não resolver o problema – especialmente nesses fóruns obscuros protegidos pelo anonimato.

"Eu tenho dúvidas de que se aumentar a pena no Código Penal surte algum efeito... Acho que temos pouco movimento nesse caso a não ser pelas regulações das tecnologias"

– Mariana Valente, Universidade Saint Gallen/InternetLab

Sem a ação das plataformas, sejam redes sociais para impedir viralização, sejam ferramentas generativas de IA para impedir a criação – as imagens da Taylor Swift foram feitas com um software da Microsoft a partir de um desafio de usuários de chan para quebrar as barreiras da ferramenta –, vai ser incrivelmente difícil prevenir e coibir esse tipo de ação.

Caso sejam vítimas de deep nudes compartilhadas nas redes, a orientação é preservar evidências (capturas de tela, prints, URLs, etc) e registrar um boletim de ocorrência em uma delegacia de crimes cibernéticos ou da mulher. Além das medidas jurídicas, é importante também procurar apoio psicológico.

O artigo 21 do Marco Civil da Internet também obriga as plataformas hospedadas no Brasil a removerem conteúdos que contenham cenas de nudez ou atos sexuais após o pedido das vítimas, sem a necessidade de decisão judicial.